SF 작가, 테드 창이 인공지능에 대한 의견을 내놨다. 파이낸셜 타임즈와의 인터뷰에서다. 기사 제목은 이렇다. ‘SF 작가 테드 창: ‘현재 우리가 갖고 있는 기계들은 의식이 없다’.

- 창은 우선 인공지능의 기능을 묘사하는 데 쓰이는 단어들의 문제점을 지적한다. 기자들이나 엔지니어들이 ChatGPT 같은 챗봇에 대해 설명하면서 “learn”, “understand”, ‘know’, 그리고 “I” 같은 인칭대명사를 쓰는 것이 오해를 불러일으킨다는 것이다.

- 창은 ‘인공지능artificial intelligence’이라는 용어 자체도 잘못됐다고 주장하면서 트위터에서 봤다는 대화를 인용한다. “인공지능이 뭔가”라는 물음에 누군가 답하길 “1954년에 있었던 나쁜 단어들의 선택”이라고 했다는 것이다. 창은 그 말에 동의한다며 이렇게 말한다. “만약 우리가 50년대에 다른 표현을 골랐더라면 지금 우리에게 일어나고 있는 수많은 혼란을 피할 수 있었을지도 모른다”.테슬라 자동차 사업만 반영 시 테슬라 주가는 결코 싸지 않다고 주장

- 기자가 창에게 그러면 인공지능 대신 어떤 용어를 쓸 수 있겠냐고 묻자 ‘applied statistics'(응용통계)라고 답한다. (artificial intelligence라는 용어의 문제는 현재 학계에서도 많이 지적된다. 주로 intelligence에 포커스가 꽂혀서 앞의 artificial은 그대로 두더라도 intelligence를 다른 표현으로 바꿔야 한다는 주장을 종종 봤다.

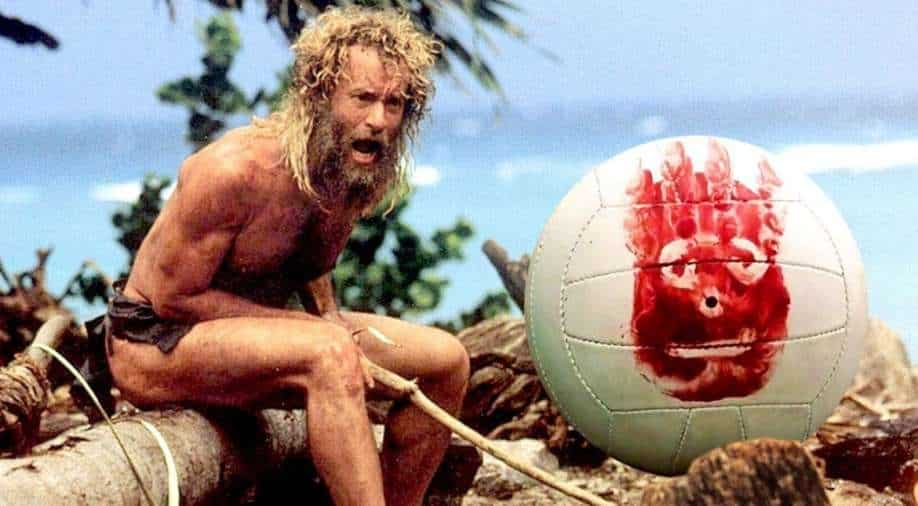

- 기자가 창에게 “사람들이 일상적으로 기계와 소통할 때 세상이 어떻게 바뀔 거라 상상하는가”하고 묻자, 창은 한참 뜸을 들이다 톰 행크스의 영화 <캐스트 어웨이> 얘기를 꺼낸다. 톰 행크스가 무인도에 고립되었을 때 친구 삼았던 배구공 ‘윌슨’에 대한 얘기다. 윌슨이 톰 행크스에게 순전한 위안이 되었던 건 사실이니 톰 행크스의 감정을 깎아내릴 건 없지만, 확실한 건 윌슨은 그저 배구공일 뿐이라는 것, 그는 배구공에 감정을 이입했다는 점이다.

이 인터뷰 내용을 간략히 번역 공유해 봅니다.

SF 작가 테드 창 : ‘현재 우리가 가진 기계는 의식이 없다’

AI의 한계, 공상 과학 소설의 활용, 그리고 ‘배구 시장 기회’가 있는 이유에 대한 선구자적인 저자

테드 창에게 점심 식사를 제의했을 때, 그의 대답은 그가 쓴 이야기처럼 간결하고 정확했습니다: “인공지능의 현재와 공상과학이 인공지능과 어떤 관련이 있는지에 대해 기꺼이 이야기하고 싶습니다.”라고 그는 답장을 보냅니다. “하지만 제 사생활에 대해서는 이야기하지 않겠습니다. 괜찮으시다면 점심을 같이 할 수 있을 것 같습니다.”

제가 관심 있는 것은 테드 창의 사생활이 아니라 그의 머릿속에 있는 세계입니다. 중국계 미국인인 그는 30여년 동안 쓴 단 18편의 단편 소설로 여러 주요 공상과학상을 수상하며 동시대 최고의 찬사를 받는 공상과학 작가 중 한 명입니다. 외계 종족과 소통하는 법을 배우는 언어학자의 이야기를 다룬 그의 소설 ‘스토리 오브 유어 라이프’는 할리우드 영화 ‘어라이벌’로 각색되기도 했습니다.

창의 수많은 이야기에는 단순함, 과학적 엄밀함, 그리고 무엇보다도 놀라운 독창성이라는 독특한 스타일의 흔적이 남아 있습니다. 그의 단편 중 하나인 “우리에게 기대되는 것”에서는 예측기라는 장치가 인류를 미치게 만듭니다. 이 가제트는 버튼과 녹색 LED 표시등으로 구성된 자동차 리모컨과 같습니다. 버튼을 누르기 1초 전에 항상 불빛이 깜빡입니다. 사람들이 그것을 능가하려고 시도하면 불가능하다는 것을 알게 됩니다. 이 개념은 이 상상의 세계에는 자유 의지가 없다는 것을 보여주며, 그럼에도 불구하고 인간이 생존을 위해 자유 의지를 믿어야 하는 이유를 설명합니다. 두 페이지 반에 모두 담겨 있습니다.

우리는 창이 아내와 함께 오랫동안 살아온 시애틀에서 호수 건너편에 있는 워싱턴주 벨뷰의 녹음이 우거진 레스토랑, 지중해식 주방에서 만나기로 약속했습니다. 55세의 마른 체격에 주름이 없는 얼굴에 흰머리를 뒤로 넘긴 채 긴 포니테일로 묶은 창이 당당하게 들어섰습니다. 그는 흰색 티셔츠와 크림색 바지를 입고 있습니다. 그는 예의 바르게 행동하지만 질문에 바로 대답하지 않는 편입니다.

“사람들은 제가 동부 해안에서 자랐다는 사실에 종종 놀라워합니다.”라고 그는 말합니다. “제가 항상 떠올리는 만화가 [존] 칼라한이 그린 만화가 있는데, 뉴욕과 LA의 차이에 대한 작은 패널입니다. 뉴욕에서는 사람이 ‘엿 먹어’라고 말하지만 말풍선에는 ‘안녕!’이라고 적혀 있습니다. LA에서는 ‘안녕’이라고 말하지만 말풍선은 ‘엿 먹어!’라는 뜻이죠.” 그는 현재 그렇게 생각하지 않는다고 약속합니다. “하지만 저는 조용한 편이죠.”

인공지능에 대해 다른 용어를 만들어야 한다면 무엇일까요? 그의 대답은 바로 응용 통계입니다.

저는 샌프란시스코에서 바로 돌아와 세계 최고의 인공지능 회사를 방문했습니다. 모두의 머릿속에는 대화형 질문에 대한 응답으로 인간과 같은 산문과 이미지를 생성할 수 있는 새로운 유형의 소프트웨어인 ‘생성형’ AI가 떠올랐습니다. 이 새로운 도구를 개발한 실리콘 밸리의 발명가들은 인간의 언어를 사용할 수 있는 기술과 함께 전례 없는 철학적 도전과 씨름하고 있습니다.

언어와 인지 사이의 관계, 초인적인 지능의 의미, 궁극적으로 우리가 세상에서 차지하는 위치의 변화 등 창의 작품을 읽은 독자라면 친숙하게 느낄 수 있는 주제들이 있습니다.

주문을 하기도 전에 웨이터를 겸하고 있는 주인장이 김이 모락모락 나는 빨간 렌틸콩 수프 두 그릇을 들고 나타납니다. 짭조름하고 매콤한 맛은 즉시 제 미각을 일깨워주었습니다. 식사를 시작하자 창은 사색에 잠긴 듯한 표정으로 자신의 가상의 세계와 우리가 살고 있는 세계가 불편할 정도로 가까워지고 있다는 제 관찰에 문제를 제기합니다.

“지금 우리가 사용하는 기계는 의식이 없습니다.” 라고 그는 말합니다. “한 사람이 다른 사람을 가르치는 것은 의식 간의 상호 작용입니다.” 한편, AI 모델은 원하는 결과를 얻기 위해 소위 ‘가중치’ 또는 모델 내 여러 변수 간의 연결 강도를 토글하여 학습합니다. “아이를 가르칠 때 네트워크에서 가중치만 조정하면 된다고 생각하는 것은 정말 큰 실수입니다.”

작가인 창의 주된 반대는 우리가 이 모든 것을 설명하기 위해 선택하는 단어에 있습니다. AI 엔지니어와 기자가 ChatGPT와 같은 챗봇에 투사하는 ‘배우다’, ‘이해하다’, ‘알다’와 같은 의인화된 언어와 ‘나’와 같은 개인 대명사는 환상을 불러일으킵니다. 이러한 성급한 속기는 이러한 시스템의 작동 원리를 잘 알고 있는 사람들조차도 AI 도구에서 아무것도 없는 감성의 불꽃을 보도록 우리 모두를 밀어붙인다고 그는 말합니다.

“얼마 전 트위터에서 누군가가 ‘인공 지능이란 무엇인가요?”라고 질문한 적이 있습니다. 그러자 다른 누군가가 ‘1954년의 잘못된 단어 선택’이라고 답했습니다.”라고 그는 말합니다. “아시다시피 그 말이 맞습니다. 50년대에 다른 표현을 선택했다면 지금과 같은 혼란을 피할 수 있었을지도 모릅니다.”라고 말합니다.

그렇다면 그에게 용어를 하나 만들어야 한다면 무엇일까요? 그의 대답은 바로 응용 통계입니다.

“대량의 텍스트에 대한 통계 분석에서 이런 종류의 정보를 추출할 수 있다는 것은 정말 놀라운 일입니다.”라고 그는 말합니다. 하지만 그렇다고 해서 이 도구가 지능적인 것은 아닙니다. 응용 통계가 훨씬 더 정확한 설명이지만, “섹시하지 않기 때문에 아무도 그 용어를 사용하고 싶어하지 않습니다.” 라고 말합니다.

…………………

2010년 출간된 창의 소설 ‘소프트웨어 객체의 수명 주기’에서 전직 사육사였던 아나는 가상 애완동물로 판매할 지각이 있는 디지털 존재(‘디지언트’라고 함)를 개발하는 AI 회사에 취직합니다. 이 기계는 오늘날의 AI와 달리 의식이 있지만 미성숙합니다. 이 소설은 수년에 걸쳐 이 사고 실험을 진행하면서 기술 개발자와 발명품의 관계, 그리고 새로운 유형의 지능이 탄생하면서 생겨난 철학적 질문들을 살펴봅니다. 인공지능은 어떤 도덕성을 가지고 있는가? 누가 그들을 책임질 것인가? 스스로 결정을 내리도록 내버려 둘 수 있을까요? 어떻게든 창의 손에서 이 이야기는 부모가 되고 놓아주는 것에 대한 내밀한 초상화가 되기도 합니다.

양자역학, 인공지능, 한계에 다다른 이론 수학 등 하나의 광대한 과학적 개념과 일, 사랑, 가족 등 평범한 인간 삶의 뉘앙스라는 두 가지 수준에서 항상 작동하는 것 같은 그의 이야기의 기원이 궁금합니다.

먼저 스모키한 바바 가누쉬, 매콤한 콜리플라워, 민트 잎을 뿌린 크리미한 라브네와 같은 다양한 딥과 올리브, 토마토와 오이 크루디테를 곁들인 메제 플래터가 차례로 등장합니다. 찍어 먹을 수 있는 따뜻한 피타 빵도 있습니다.

“저에게는 아이디어가 떠오르면 거의 바로 사라지는 경우가 많아요. 하지만 어떤 아이디어는 몇 달 또는 몇 년에 걸쳐 계속해서 떠오르기도 합니다.”라고 창은 바삭한 콜리플라워를 집어먹으며 말합니다. “그러면 저는 이 아이디어가 스토리를 써야 할 것 같다는 생각이 들기 시작합니다. 어떤 이유에서인지 이 아이디어가 저를 가만히 놔두지 않으니까요.”

제가 미처 생각을 정리하기도 전에 파바와 가르반조 콩을 올리브 오일과 레몬즙에 버무려 천천히 익힌 스튜인 창의 파울 무담마와 페타와 시금치로 속을 채운 필로 페이스트리인 스파나코피타가 사프란 라이스와 후무스를 곁들인 채로 나왔습니다. 테이블에서 신음 소리가 들리는 것 같았어요.

창이 자주 돌아오는 주제는 언어가 우리의 사고 방식과 정체성을 형성하는 방식, 그리고 자유 의지의 존재입니다.

2019년작 ‘불안은 자유의 현기증’에서 사람들은 공상 과학 소설의 흔한 소재인 평행 우주로 통하는 포털을 열고 자신의 또 다른 자아와 대화합니다. 그의 초기 아이디어는 그런 장치가 어떤 모습일지, 그리고 양자 컴퓨터를 사용하여 어떻게 작동할지에 대해 글을 쓰는 것이었습니다.

그러나 이 이야기는 또한 사람들의 변화하는 주체성에 대한 감각, 즉 분신이 다르게 행동할 때 캐릭터의 결정에 대한 무게가 어떻게 사라지는지에 대해서도 탐구했습니다. “그런 생각을 점점 더 많이 하게 되었고, 자유 의지에 대한 이야기로 발전하게 되었습니다.”

챗봇이 아무도 읽거나 쓰고 싶어 하지 않는 필러 텍스트를 생성하는 것에 대해 그는 챗봇의 능력에 대한 확고한 지지는 아니라고 말합니다. That’s not exactly a resounding endorsement of their abilities, he says of chatbots producing filler text that no one necessarily wants to read or write

그의 이야기는 복잡한 개념을 구현하지만, 창은 단편 소설 형식을 고수하고 있으며, 이는 공상 과학 소설의 오랜 전통의 일부라고 지적합니다. 그는 15세 때 아서 C 클라크와 아이작 아시모프에게 영감을 받아 잡지에 첫 단편 소설을 투고했습니다. 마거릿 애트우드나 가즈오 이시구로와 같은 문학이나 사변 소설 작가보다는 이러한 전통에 확고한 정체성을 두고 있지만, 그의 작품은 어떻게든 장르의 경계를 넘어 할리우드에 이르기까지 완전히 새로운 관객에게 다가가고 있습니다.

“제 작품이 공상 과학 소설을 즐겨 읽지 않는 독자들에게도 전달되었다는 사실이 저에게는 완전히 놀라운 일이었습니다. 상상도 하지 못했던 일이었죠.”라고 창은 말합니다. 몇몇 문학 에이전트는 그의 작품이 주류 독자에게는 절대 통하지 않을 것이라고 말했습니다.

하지만 그는 자신이 글을 쓰는 이유는 그것이 의무이기 때문이라고 말합니다. 그는 작가 애니 딜라드의 말을 인용합니다: “설명하기 어려운 이유로 흥미를 느끼는 무언가가 있습니다. 설명하기 어려운 이유는 한 페이지도 읽지 않았기 때문이며, 거기서부터 시작됩니다. 여러분은 이 놀라움에 목소리를 내도록 만들어졌고 여기에 설정되어 있습니다.”

“아직 아무도 그것을 표현하지 않았기 때문에 흥미롭고, 여러분은 그것을 표현하고 싶어 합니다.”라고 창은 말합니다. “그리고 그것이 바로 여러분이 하는 일입니다.”

……………

창은 근처 벨뷰 다운타운 공원에서 점심을 먹으러 가자고 제안합니다. 저는 바클라바를 나눠 먹기 위해 조금만 더 머물자고 그를 설득합니다. 그는 레스토랑으로 사라지고 작은 흰색 접시에 직접 바클라바를 가져와서 한 입에 한 개씩 맛있게 먹었습니다.

언어와 지능의 관계에 대한 그의 관심을 감안할 때, ChatGPT와 같은 인공지능이 생성하는 텍스트 유형에 대한 그의 견해가 특히 궁금합니다. 기계가 생성하는 단어가 우리 둘의 글쓰기 유형을 어떻게 바꿀까요? 대화 도중 처음으로 짜증이 치밀어 올랐습니다. “사람들에게 말을 건네는 글을 쓰는 건가요? 실제로 사람들에게 말을 건넨 ChatGPT 생성 에세이가 있었나요?”라고 그는 말합니다.

창의 견해에 따르면 ChatGPT나 Google의 Bard와 같은 챗봇의 기반 기술인 대규모 언어 모델(또는 LLM)은 인류학자 데이비드 그레이버가 “엉터리 작업”이라고 불렀던, 아무도 읽거나 쓰고 싶어 하지 않는 필러 텍스트를 생성하는 데 주로 유용하다고 합니다. 그는 AI가 생성한 텍스트가 유쾌하지는 않지만 특정 분야에서는 유용할 수 있다고 인정합니다.

“하지만 법학석사 학위 소지자가 그런 일을 할 수 있다는 사실 자체가 그들의 능력을 인정하는 것은 아닙니다.”라고 그는 말합니다. “그것은 우리가 일상 생활에서 얼마나 많은 헛소리를 만들어내고 처리해야 하는지에 대한 진술에 가깝습니다.”

창은 소수의 손에 권력이 집중되는 AI로 인해 악화되는 불평등을 우려하고 있습니다. Chiang is worried about increasing inequality, exacerbated by AI, which concentrates power in the hands of a few

창은 지난 2월 뉴요커에 게재된 “ChatGPT는 웹의 흐릿한 JPEG”라는 제목의 바이럴 에세이에서 자신의 생각을 개괄적으로 설명했습니다. 그는 언어 모델을 학습된 텍스트의 흐릿한 모조품으로, 문법 규칙을 따르는 단어 순서를 재배열한 것이라고 설명합니다. 이 기술은 이미 존재하는 것과 약간 다른 자료를 재구성하기 때문에 이해력이 있다는 인상을 줍니다.

이를 언어를 배우는 아이들과 비교하면서 저는 제 다섯 살짜리 아이가 어떻게 한 줄짜리 농담(주로 말장난)을 만들어서 우리에게 시험해 보았는지에 대해 이야기해 주었습니다. 그 일화를 들으며 그는 활짝 웃었습니다.

“따님이 농담을 듣고 재미있다고 생각했군요. ChatGPT는 웃기는 것을 찾지 못했고 웃기려고 노력하지도 않습니다. 딸이 하는 일에는 엄청난 사회적 요소가 있습니다.”라고 그는 말합니다.

한편 ChatGPT는 “다음에 함께 어울릴 때 웃음을 자아낼 수 있는지 확인하기 위해 정신적으로 리허설을 하는 것”이 아닙니다. 창은 인간의 의도, 감정, 목적이 없는 언어는 무의미하다고 믿습니다. “언어는 다른 존재와의 상호작용을 촉진하는 수단입니다. 이는 현재 AI 도구가 가지고 있는 일종의 다음 토큰 예측과는 완전히 다른 것입니다.”

밝은 분홍색 수국 덤불과 광활한 수경시설이 있는 공원을 산책하기 좋은 날입니다. 우리는 공상 과학 소설이 중요한 이유에 대해 논의하면서 빠른 속도로 이야기를 시작했습니다. 선동하기 위해 글을 쓰는 것은 아니지만, 그는 공상과학이 어떻게 급진적인 힘을 발휘할 수 있는지 잘 알고 있습니다. “공상과학 소설은 변화에 관한 것이며, 사람들이 지금과는 다른 세상을 상상할 수 있도록 도와줍니다.”라고 그는 말합니다.

영국의 문화 비평가이자 정치 이론가인 마크 피셔가 한 말과 같습니다. 창의 표현을 빌리자면, 해방 정치의 역할은 우리가 필연적이라고 말하는 것들이 사실은 우연적이라는 것을 드러내는 것입니다. 그리고 우리가 불가능하다고 말하는 것들도 사실은 달성할 수 있습니다. “공상과학 소설에 대해서도 같은 말을 할 수 있다고 생각합니다.”

창은 정치와 공상과학을 혼합하지는 않지만, AI가 자본주의의 ‘힘의 승수’가 될 수 있다고 우려합니다. 2017년 버즈피드에 기고한 에세이에서 그는 기술자들을 “부정적인 결과가 초래될 가능성은 전혀 고려하지 않고 오로지 목표에만 집중하는” 초지능적인 AI 창조물에 비유했습니다.

사람과 상호작용하는 것이 어렵다는 것은 이해합니다. 많은 것을 요구하고 종종 보람도 없죠. 소셜 챗봇은 사람들에게 위로와 진정한 위안을 제공할 수 있습니다. I get it, interacting with people is hard. It demands a lot, it is often unrewarding. Social chatbots could provide comfort, real solace to people

그가 두려워하는 것은 연구자들이 예측하는 것처럼 인공지능이 세상을 장악하는 종말의 시나리오가 아닙니다. 그는 소수의 손에 권력이 집중되는 AI와 같은 기술로 인해 불평등이 심화되는 것을 훨씬 더 걱정하고 있습니다.

이제 공원을 몇 바퀴 돌고 나니 다른 산책객들, 즉 모녀 커플, 두 발로 걷는 개를 데리고 온 여성, 벤치에 앉아 책과 잡지, 아이스크림을 먹는 사람들이 눈에 들어오기 시작했습니다. 저는 창에게 사람들이 기계와 일상적으로 소통하게 되면 세상이 어떻게 바뀔 것이라고 상상하는지 물었습니다.

몇 분간 조용히 걷다가 갑자기 톰 행크스의 영화 ‘캐스트 어웨이(Cast Away)’를 기억하냐고 묻더군요. 행크스가 사는 섬에는 윌슨이라는 배구공이 있는데, 윌슨은 행크스가 사랑하는 유일한 동반자입니다. “저는 그것이 이러한 시스템에 대해 더 유용하게 생각할 수 있는 방법이라고 생각합니다.”라고 그는 말합니다. “윌슨은 톰 행크스에게 진정한 위안을 주었기 때문에 윌슨에 대한 톰 행크스의 캐릭터가 느끼는 감정이 줄어들지는 않습니다. 하지만 문제는 윌슨이 배구공에 자신을 투영하고 있다는 점입니다. 그 안에는 다른 사람이 없습니다.”

그는 사람들이 서로 대화하는 것보다 AI 시스템과 대화하는 것을 선호하게 되는 이유를 인정합니다. “사람과 대화하는 것이 어렵다는 것은 이해합니다. 힘들죠. 많은 것을 요구하고 종종 보람도 없죠.”라고 그는 말합니다. 하지만 그는 현대의 삶이 사람들을 외딴 사막의 섬에 고립시켜 동반자를 갈망하게 만들었다고 생각합니다. “바로 이 때문에 배구공에 대한 시장 기회가 생겼습니다.”라고 그는 말합니다. “소셜 챗봇은 윌슨이 제공하는 것과 같은 방식으로 사람들에게 위로와 진정한 위안을 제공할 수 있습니다.”

하지만 궁극적으로 우리의 삶을 의미 있게 만드는 것은 사람과 사람 사이의 상호작용, 즉 사람과 사람이 서로 반응하는 과정에서 얻는 공감과 의도입니다. 그는 AI를 사용하면 “상대방이 있는 것처럼 느껴집니다. 하지만 실제로는 없습니다. “

테드 창 인터뷰 기사 원문

Sci-fi writer Ted Chiang: ‘The machines we have now are not conscious’

The visionary author on the limits of AI, the uses of science fiction — and why there’s a ‘market opportunity for volleyballs’

When I ask Ted Chiang if he will sit down with me over lunch, his response — like the stories he writes — is succinct and precise: “I’d be happy to talk about the current moment in AI and how science fiction relates to it,” he writes back. “But I won’t talk about my personal life. If that’s OK with you, I’m available for lunch.”

It’s not Chiang’s personal life I’m interested in: it’s the worlds inside his head. The Chinese-American writer is one of the most lauded science-fiction writers of his generation, having won multiple major sci-fi awards for the mere 18 short stories he has written over 30-odd years. His novella Story of Your Life, about a linguist who learns to communicate with an alien species, was adapted into the Hollywood film Arrival.

Chiang’s score of stories bear the marks of his distinctive style: simplicity, scientific rigour and, above all, a startling originality. In one of his shortest stories, “What’s Expected of Us”, a device called a Predictor drives humanity insane. The gadget is like a car remote, consisting of a button and a green LED light. The light always flashes one second before you press the button. When people try to outsmart it, they find that to be impossible. The concept demonstrates the lack of free will in this imagined world — and yet why humans need to believe in it in order to survive. All in two-and-a-half pages.

We’ve agreed to meet at Mediterranean Kitchen, a no-frills restaurant in leafy Bellevue, Washington state, just across the lake from Seattle, where Chiang has lived with his wife for many years. Chiang walks in diffidently, 55 years old, lean and spare, with an unlined face and grey-streaked hair that he wears pulled back in a long ponytail. He’s dressed in a white T-shirt and cream trousers. He is polite but never responds to a question immediately if he can help it.

“People are often surprised to learn I grew up on the East Coast,” he says. “There’s this cartoon by this cartoonist [John] Callahan that I always think of — it’s a little panel of the difference between New York and LA. And in New York, the person says, ‘fuck you’, but the thought bubble is ‘hi there!’ And in LA, the person says, ‘Hi there’, but the thought bubble is ‘fuck you!’” He promises me that isn’t what he’s currently thinking. “But I guess I’m quiet.”

So if he had to invent a different term for artificial intelligence, what would it be? His answer is instant: applied statistics

I’ve come straight from San Francisco, where I visited world-leading artificial intelligence companies. On everybody’s minds was “generative” AI, a new type of software that can produce human-like prose and imagery in response to conversational queries. Silicon Valley inventors of these new tools are grappling with unprecedented philosophical challenges that come with a technology that can use human language.

These are themes with which readers of Chiang’s work will be familiar: the relationship between language and cognition, the implications of a superhuman intelligence, and ultimately, the shifting nature of our place in the world.

Before we have had a chance to order, the proprietor, who also doubles as the waiter, turns up with two steaming bowls of peppery red lentil soup. The flavours instantly awaken my taste buds: salty and pungent. As we dive in, Chiang, in his contemplative way, takes issue with my observation that his fictional worlds and the one we’re inhabiting are getting uncomfortably close together.

“The machines we have now, they’re not conscious,” he says. “When one person teaches another person, that is an interaction between consciousnesses.” Meanwhile, AI models are trained by toggling so-called “weights” or the strength of connections between different variables in the model, in order to get a desired output. “It would be a real mistake to think that when you’re teaching a child, all you are doing is adjusting the weights in a network.”

Chiang’s main objection, a writerly one, is with the words we choose to describe all this. Anthropomorphic language such as “learn”, “understand”, “know” and personal pronouns such as “I” that AI engineers and journalists project on to chatbots such as ChatGPT create an illusion. This hasty shorthand pushes all of us, he says — even those intimately familiar with how these systems work — towards seeing sparks of sentience in AI tools, where there are none.

“There was an exchange on Twitter a while back where someone said, ‘What is artificial intelligence?’ And someone else said, ‘A poor choice of words in 1954’,” he says. “And, you know, they’re right. I think that if we had chosen a different phrase for it, back in the ’50s, we might have avoided a lot of the confusion that we’re having now.”

So if he had to invent a term, what would it be? His answer is instant: applied statistics.

“It’s genuinely amazing that . . . these sorts of things can be extracted from a statistical analysis of a large body of text,” he says. But, in his view, that doesn’t make the tools intelligent. Applied statistics is a far more precise descriptor, “but no one wants to use that term, because it’s not as sexy”.

…………………

In The Lifecycle of Software Objects, Chiang’s 2010 novella, former zookeeper Ana takes a job at an AI company developing sentient digital beings (known as “digients”) to be sold as virtual pets. These machines, unlike the AI of today, are conscious but immature. The novella spools this thought experiment out over many years, examining the relationships between tech creators and their inventions as they develop, and also the philosophical questions spawned by the creation of a new type of intelligence. What sort of morals do they have? Who is responsible for them? Can they be left to make their own decisions? Somehow, in Chiang’s hands, the story also becomes an intimate portrait of parenthood and letting go.

I’m curious about the origins of his stories, which always seem to work on two levels: the single expansive scientific concept such as quantum mechanics, AI or theoretical mathematics pushed to its limits — and the nuances of ordinary human life: work, love and family.

We are interrupted by our food arriving in rapid succession: first, a meze platter to share, with a selection of dips such as smoky baba ganoush, spiced cauliflower and creamy labneh flecked with mint leaves, accompanied by olives and crudités of tomatoes and cucumber. There’s warm pita bread for dipping too.

“For me, ideas come and then oftentimes they go almost immediately afterwards. But sometimes an idea keeps coming back to me again and again, over a period of months or years,” Chiang says, tucking into the crispy cauliflower. “Then I start to suspect maybe this is something that I need to write a story about. Because for some reason this idea won’t leave me alone.”

Before I’ve made much headway, Chiang’s foul mudammas, a slow-cooked stew of fava and garbanzo beans tossed in olive oil and lemon juice, and my spanakopita — filo pastry stuffed with feta and spinach — appear, both served with a mound of saffron rice and hummus on the side. I can almost hear the table groan.

There are themes to which Chiang returns often: namely, the ways in which language shapes how we think and who we are; and the existence of free will.

In his 2019 story Anxiety Is the Dizziness of Freedom, people routinely open a portal to a parallel universe — a common trope of science fiction — and converse with their alternate selves. His initial idea was to write about what such a device would look like, and how that would work using quantum computers.

But the story also explored people’s changing sense of their own agency; how the weight of his characters’ decisions somehow vanished when their alter-egos acted differently. “I just started thinking more and more about that, and then that turned into a story that was sort of about free will.”

That’s not exactly a resounding endorsement of their abilities, he says of chatbots producing filler text that no one necessarily wants to read or write

Although his stories embody complex concepts, Chiang has stuck to the short story form, which he points out is part of a long tradition in science fiction. He submitted his first short story to a magazine at the age of 15, inspired by the likes of Arthur C Clarke and Isaac Asimov. And while he firmly identifies in this tradition, rather than with literary or speculative fiction writers such as Margaret Atwood or Kazuo Ishiguro, his work somehow reaches across the boundaries of genre to an entirely new audience — all the way into Hollywood.

“I have to say that the fact that my work has reached readers who are not regular science-fiction readers has been a complete surprise to me. It was not something that I ever imagined,” Chiang says. Several literary agents told him his work would never cross over to mainstream audiences.

The reason he writes, he says, is because it is an imperative. He quotes writer Annie Dillard who said: “There’s something you find interesting, for a reason hard to explain. It is hard to explain because you have never read it on any page; there you begin. You were made and set here to give voice to this, your own astonishment.”

“It is interesting precisely because no one else has articulated it yet, and you want to,” says Chiang. “And so that’s what you do.”

…………………….

Chiang suggests we walk off our lunch at the nearby Bellevue Downtown Park. I persuade him to stay just a while longer, to share some baklava. He disappears into the restaurant and brings them out himself on a small white plate, one square each that we eat in a single, delicious mouthful.

Given his fascination with the relationship between language and intelligence, I’m particularly curious about his views on AI writing, the type of text produced by the likes of ChatGPT. How, I ask, will machine-generated words change the type of writing we both do? For the first time in our conversation, I see a flash of irritation. “Do they write things that speak to people? I mean, has there been any ChatGPT-generated essay that actually spoke to people?” he says.

Chiang’s view is that large language models (or LLMs), the technology underlying chatbots such as ChatGPT and Google’s Bard, are useful mostly for producing filler text that no one necessarily wants to read or write, tasks that anthropologist David Graeber called “bullshit jobs”. AI-generated text is not delightful, but it could perhaps be useful in those certain areas, he concedes.

“But the fact that LLMs are able to do some of that — that’s not exactly a resounding endorsement of their abilities,” he says. “That’s more a statement about how much bullshit we are required to generate and deal with in our daily lives.”

Chiang is worried about increasing inequality, exacerbated by AI, which concentrates power in the hands of a few

Chiang outlined his thoughts in a viral essay in The New Yorker, published in February, titled “ChatGPT Is a Blurry JPEG of the Web”. He describes language models as blurred imitations of the text they were trained on, rearrangements of word sequences that obey the rules of grammar. Because the technology is reconstructing material that is slightly different to what already exists, it gives the impression of comprehension.

As he compares this to children learning language, I tell him about how my five-year-old has taken to inventing little one-line jokes, mostly puns, and testing them out on us. The anecdote makes him animated.

“Your daughter has heard jokes and found them funny. ChatGPT doesn’t find anything funny and it is not trying to be funny. There is a huge social component to what your daughter is doing,” he says.

Meanwhile ChatGPT isn’t “mentally rehearsing things in order to see if it can get a laugh out of you the next time you hang out together”. Chiang believes that language without the intention, emotion and purpose that humans bring to it becomes meaningless. “Language is a way of facilitating interactions with other beings. That is entirely different than the sort of next-token prediction, which is what we have [with AI tools] now.”

It’s a glorious day for a walk in the park, especially this verdant space with bright pink hydrangea bushes and expansive water features. We start off at a brisk pace, discussing why science fiction matters. Although he doesn’t write in order to incite, he sees how sci-fi could be a radicalising force. “Science fiction is about change, and helping people imagine the world is different than it is now,” he says.

It’s like what Mark Fisher, the British cultural critic and political theorist, once said. Chiang paraphrases: the role of emancipatory politics is to reveal that the things we are told are inevitable are in fact contingent. And the things that we are told are impossible are in fact achievable. “I think the same thing could be said about science fiction.”

Although Chiang doesn’t mix politics with his fiction, he does worry that AI is a “force multiplier” for capitalism. In an essay for BuzzFeed in 2017, he compared technologists to their supposedly superintelligent AI creations: entities that “[pursue] their goals with monomaniacal focus, oblivious to the possibility of negative consequences”.

I get it, interacting with people is hard. It demands a lot, it is often unrewarding. Social chatbots could provide comfort, real solace to people

His fear isn’t about a doomsday scenario, like researchers predict, where AI takes over the world. He is far more worried about increasing inequality, exacerbated by technologies such as AI, which concentrates power in the hands of a few.

By now, we’ve done a few laps of the park, and I begin to recognise some of the other walkers: a mother-and-daughter duo, a lady with a two-legged dog, and people sitting on benches, with books, magazines and ice-creams. I turn to Chiang, asking how he imagines the world will change when people routinely communicate with machines.

We walk in silence for a few minutes and then suddenly he asks me if I remember the Tom Hanks film Cast Away. On his island, Hanks has a volleyball called Wilson, his only companion, whom he loves. “I think that that is a more useful way to think about these systems,” he tells me. “It doesn’t diminish what Tom Hanks’ character feels about Wilson, because Wilson provided genuine comfort to him. But the thing is that . . . he is projecting on to a volleyball. There’s no one else in there.”

He acknowledges why people may start to prefer speaking to AI systems rather than to one another. “I get it, interacting with people, it’s hard. It’s tough. It demands a lot, it is often unrewarding,” he says. But he feels that modern life has left people stranded on their own desert islands, leaving them yearning for companionship. “So now because of this, there is a market opportunity for volleyballs,” he says. “Social chatbots, they could provide comfort, real solace to people in the same way that Wilson provides.”

But ultimately, what makes our lives meaningful is the empathy and intent we get from human interactions — people responding to one another. With AI, he says: “It feels like there’s someone on the other end. But there isn’t.”